Jake Moore de ESET utilizó gafas inteligentes, deepfakes e intercambios de rostros para «piratear» sistemas de reconocimiento facial ampliamente utilizados, y lo demostrará todo en RSAC 2026.

13 de marzo de 2026

•

,

2 min. leer

El reconocimiento facial está cada vez más integrado en todo, desde las puertas de embarque de los aeropuertos hasta los flujos de incorporación de los bancos. La suposición generalizada es que un rostro es difícil de falsificar y que hacer coincidir un rostro real con una fuente confiable es una señal de identidad confiable.

Jake Moore, asesor de ciberseguridad global de ESET, recientemente sometió esta suposición a varias pruebas de estrés prácticas. Sus experimentos demostraron que esta poderosa tecnología puede ser mal utilizada o derrotada.

En una prueba, Jake utilizó un par de gafas inteligentes modificadas disponibles en el mercado que pueden identificar personas en tiempo real. Caminó por un espacio público, capturó los rostros de las personas y los comparó con fuentes de datos en línea disponibles públicamente, y obtuvo coincidencias de identidad en segundos. Los nombres y los perfiles de las redes sociales se obtuvieron nada más que de las miradas de las personas.

Esta capacidad puede resultar útil si, por ejemplo, un asistente a una conferencia tiene dificultades para recordar los nombres de las personas, pero es mucho menos aceptable si se considera lo que alguien con malas intenciones podría hacer con esa información.

La segunda demostración tuvo un giro diferente. Atacó los servicios financieros y puso en su contra un sistema de prevención de fraude. Utilizando imágenes generadas por IA y software disponible gratuitamente, Jake creó una cara ficticia para abrir una cuenta bancaria real. El reconocimiento facial del banco y la plataforma eKYC (conoce a tu cliente) lo aceptaron como una persona genuina.

Después de demostrarlo, Jake cerró la cuenta y compartió toda la información con el banco, que desde entonces cerró ese método específico de abuso de identidad. Pero queda una pregunta más amplia: ¿cuántas instituciones financieras aún pueden ser susceptibles a este tipo de ataque?

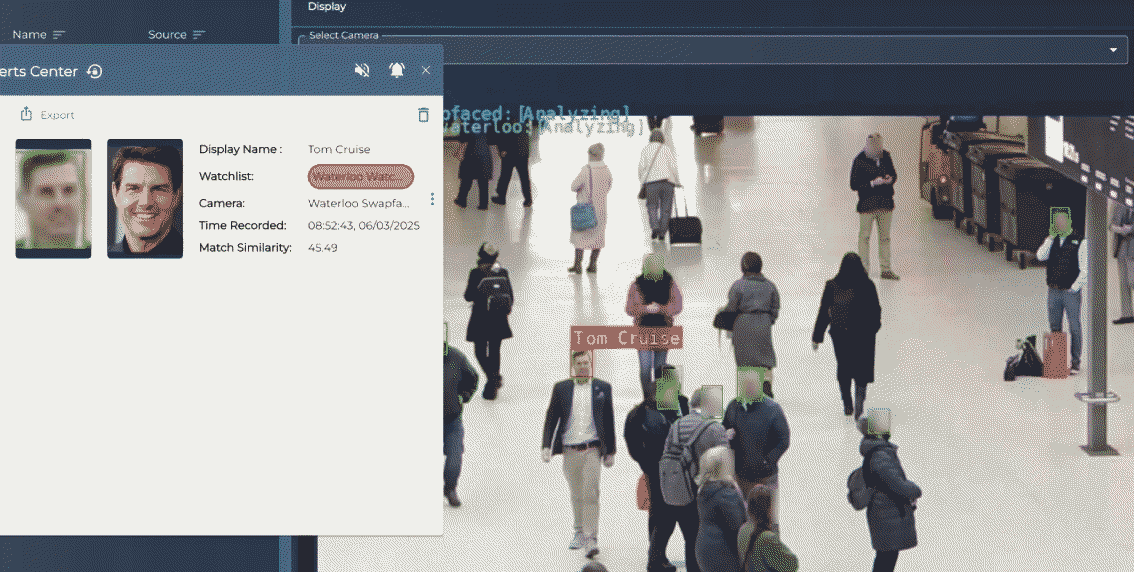

Por último, Jake se añadió a una lista de vigilancia por reconocimiento facial en una concurrida estación de tren de Londres. Luego caminó por el área monitoreada mientras ejecutaba un software de intercambio de rostros en tiempo real que superponía la imagen de Tom Cruise a la de Jake en la transmisión de la cámara. El sistema, que también utiliza la policía del Reino Unido, nunca lo reconoció ni lo marcó. Era como si simplemente no estuviera allí y cualquiera que lo buscara activamente en CCTV hubiera visto al actor.

Hay mucho más en estos experimentos de lo que podemos cubrir aquí: todos son parte de La charla de Jake en RSAC 2026que se presentará en San Francisco a partir del 23 de marzo.tercero-26th2026. Si está en la conferencia, considere asistir a la charla; después de todo, ver cómo funciona todo esto en un sistema en producción en un entorno real es diferente a «simplemente» leer sobre ello. Para obtener más información, incluso sobre otras charlas de ESET en la conferencia, visite este sitio web.

El panorama general

Los sistemas de reconocimiento facial se están implementando con una confianza implícita que no coincide con su resistencia real cuando alguien intenta romperlos, incluso cuando solo usan hardware de consumo y software fácilmente disponible, tal como lo hizo Jake. La verificación de identidad que depende únicamente de una coincidencia facial claramente conlleva más riesgos de lo que la mayoría de las personas y organizaciones creen.

Los experimentos también envían un mensaje a los proveedores de sistemas de reconocimiento facial y a cualquier persona responsable de los sistemas de verificación de identidad. Entre otras cosas, los sistemas deberían probarse en entornos de simulación de ataques y en otras condiciones adversas. La tecnología detrás del reconocimiento facial es frágil en aspectos que importan cuando alguien intenta subvertirla.