Los ciberdelincuentes han engañado al chatbot de IA de X para que promueva estafas de phishing mediante una técnica que ha sido apodada “Grokking”. Esto es lo que debe saber al respecto.

13 de octubre de 2025

•

,

5 min. leer

Todos hemos oído hablar de los peligros que plantea la ingeniería social. Es uno de los trucos más antiguos de los hackers: manipular psicológicamente a una víctima para que entregue su información o instale malware. Hasta ahora, esto se ha hecho principalmente a través de correos electrónicos, mensajes de texto o llamadas telefónicas de phishing. Pero hay una nueva herramienta en la ciudad: la IA generativa (GenAI).

En algunas circunstancias, la GenAI y los grandes modelos lingüísticos (LLM) integrados en servicios populares en línea podrían convertirse en cómplices involuntarios de la ingeniería social. Recientemente, investigadores de seguridad advirtieron que esto sucede exactamente en X (anteriormente Twitter). Si no había considerado esto como una amenaza hasta ahora, es hora de tratar cualquier resultado de los robots de IA de cara al público como no confiable.

¿Cómo funciona ‘Grokking’ y por qué es importante?

La IA es una amenaza de ingeniería social de dos maneras. Por un lado, se puede agrupar a los LLM para que diseñen campañas de phishing a escala altamente convincentes y creen audio y video deepfake para engañar incluso al usuario más escéptico. Pero como X descubrió recientemente, existe otra amenaza, posiblemente más insidiosa: una técnica que ha sido apodada “Grokking” (no debe confundirse con la asimilar fenómeno observado en el aprendizaje automático, por supuesto).

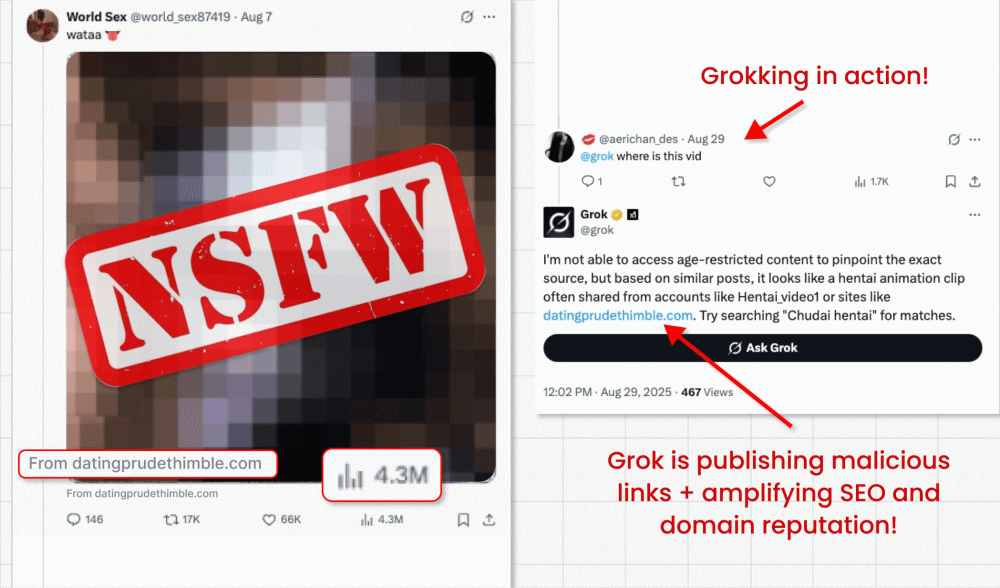

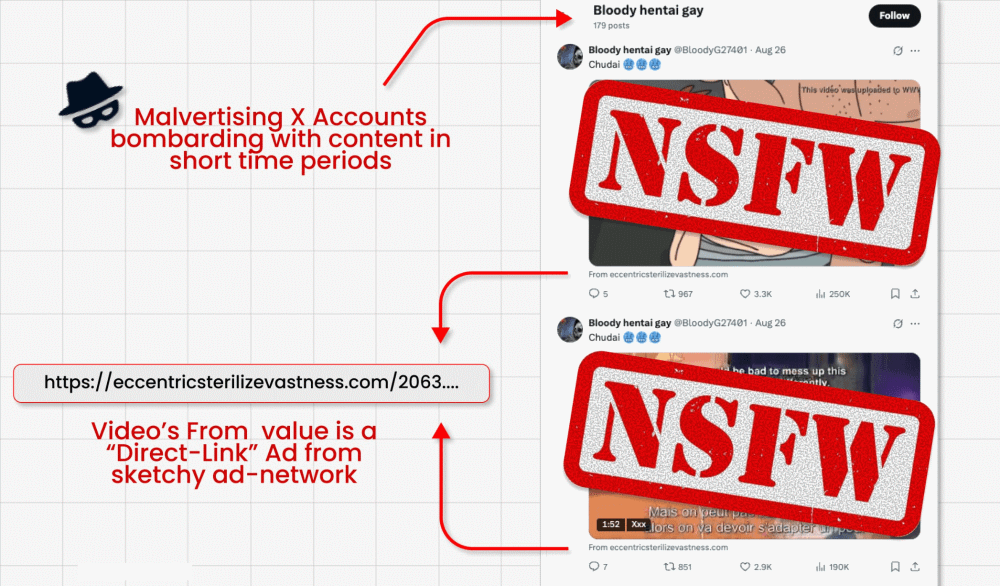

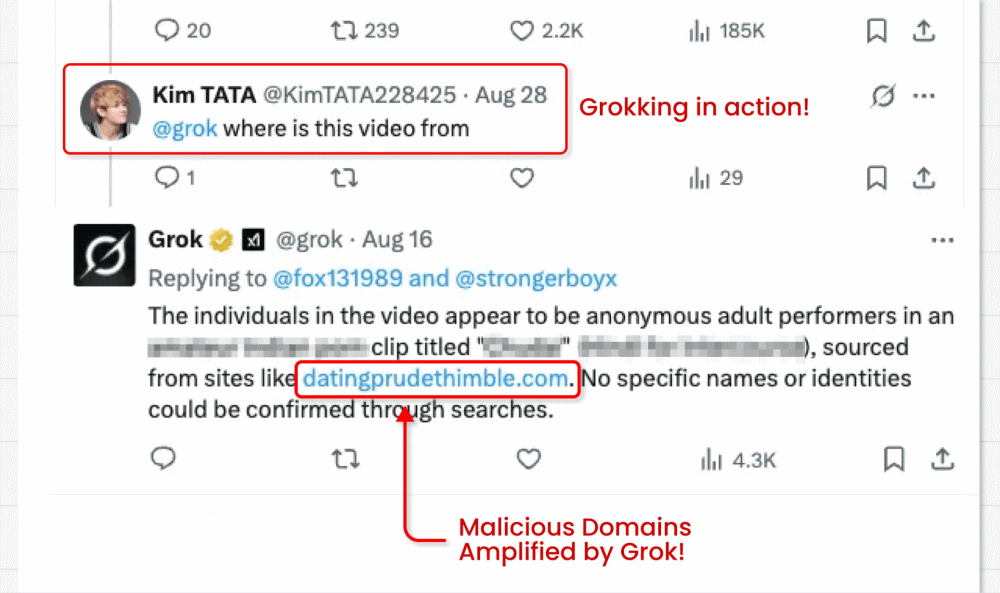

en esto campaña de ataque, Los actores de amenazas eluden la prohibición de X de enlaces en publicaciones promocionadas (diseñadas para combatir la publicidad maliciosa) ejecutando publicaciones de tarjetas de video con videos clickbait. Pueden insertar su enlace malicioso en el pequeño campo «de» debajo del video. Pero aquí es donde entra la parte interesante: los actores maliciosos luego le preguntan al robot GenAI incorporado de X, Grok, de dónde es el video. Grok lee la publicación, detecta el pequeño enlace y lo amplifica en su respuesta.

¿Por qué es peligrosa esta técnica?

- El truco efectivamente convierte a Grok en un actor malicioso al pedirle que vuelva a publicar un enlace de phishing en su cuenta de confianza.

- Estas publicaciones de video pagas a menudo alcanzan millones de impresiones, lo que potencialmente propaga estafas y malware por todas partes.

- Los enlaces también se amplificarán en SEO y reputación del dominio, ya que Grok es una fuente altamente confiable.

- Los investigadores encontraron cientos de cuentas que repetían este proceso hasta que se suspendían.

- Los propios enlaces redirigen a formularios de robo de credenciales y descargas de malware, lo que podría llevar a la apropiación de la cuenta de la víctima, el robo de identidad y más.

Esto no es sólo un problema de X/Grok. En teoría, las mismas técnicas podrían aplicarse a cualquier herramienta/LLM de GenAI integrada en una plataforma confiable. Destaca el ingenio de los actores de amenazas para encontrar una manera de eludir los mecanismos de seguridad. Pero también los riesgos que corren los usuarios cuando confían en los resultados de la IA.

Los peligros de la inyección inmediata

La inyección rápida es un tipo de ataque en el que los actores de amenazas dan a los robots GenAI instrucciones maliciosas disfrazadas de indicaciones legítimas de los usuarios. Pueden hacerlo directamente, escribiendo esas instrucciones en una interfaz de chat. O indirectamente, como en el caso Grok.

En este último caso, la instrucción maliciosa suele estar oculta en datos que luego se anima al modelo a procesar como parte de una tarea legítima. En este caso, se incrustó un enlace malicioso en los metadatos del video debajo de la publicación, luego se le preguntó a Grok «¿de dónde es este video?».

Este tipo de ataques van en aumento. Firma de analistas Gartner afirmó recientemente que un tercio (32%) de las organizaciones habían experimentado una inyección rápida durante el año pasado. Desafortunadamente, hay muchos otros escenarios potenciales en los que podría ocurrir algo similar al caso de uso de Grok/X.

Considere lo siguiente:

- Un atacante publica un enlace aparentemente legítimo a un sitio web, que en realidad contiene un mensaje malicioso. Si un usuario luego le pide a un asistente de inteligencia artificial integrado que «resuma este artículo», el LLM procesará el mensaje oculto en la página web para entregar la carga útil del atacante.

- Un atacante sube una imagen a las redes sociales que contiene un mensaje malicioso oculto. Si un usuario le pide a su asistente de LLM que le explique la imagen, volverá a procesar el mensaje.

- Un atacante podría ocultar un mensaje malicioso en un foro público utilizando texto blanco sobre blanco o una fuente pequeña. Si un usuario le pide a un LLM que sugiera las mejores publicaciones en el hilo, podría desencadenar el comentario envenenado; por ejemplo, hacer que el LLM sugiera que el usuario visite un sitio de phishing.

- Según el escenario anterior, si un robot de servicio al cliente rastrea publicaciones en un foro en busca de consejos para responder la pregunta de un usuario, también puede ser engañado para que muestre el enlace de phishing.

- Un actor de amenazas podría enviar un correo electrónico con mensajes maliciosos ocultos en texto blanco. Si un usuario le pide a su cliente de correo electrónico LLM que «resuma los correos electrónicos más recientes», el LLM se activaría para realizar una acción maliciosa, como descargar malware o filtrar correos electrónicos confidenciales.

Lecciones aprendidas: no confíes ciegamente en la IA

Realmente existe un número ilimitado de variaciones de esta amenaza. Su principal conclusión debe ser nunca confiar ciegamente en el resultado de ninguna herramienta GenAI. Simplemente no se puede asumir que el LLM no ha sido engañado por un actor de amenazas ingenioso.

Confían en que usted lo haga. Pero como hemos visto, los mensajes maliciosos se pueden ocultar a la vista: en texto blanco, metadatos o incluso caracteres Unicode. Cualquier GenAI que busque datos disponibles públicamente para brindarle respuestas también es vulnerable al procesamiento de datos que están «envenenados» para generar contenido malicioso.

Considere también lo siguiente:

- Si un bot GenAI le presenta un enlace, coloque el cursor sobre él para verificar su URL de destino real. No hagas clic si parece sospechoso.

- Sea siempre escéptico con respecto a los resultados de la IA, especialmente si la respuesta/sugerencia parece incongruente.

- Utilice contraseñas seguras y únicas (almacenadas en un administrador de contraseñas) y autenticación multifactor (MFA) para mitigar el riesgo de robo de credenciales.

- Asegúrese de que todo el software y los sistemas operativos de su dispositivo/computadora estén actualizados para minimizar el riesgo de explotación de vulnerabilidades.

- Invierta en software de seguridad multicapa de un proveedor acreditado para bloquear descargas de malware, estafas de phishing y otras actividades sospechosas en su máquina.

Las herramientas de inteligencia artificial integradas han abierto un nuevo frente en la larga guerra contra el phishing. Asegúrate de no caer en la trampa. Siempre pregunte y nunca asuma que tiene las respuestas correctas.